Category Archives: Exhibition Design

©Shohei Fujimoto und Creative Applications Network

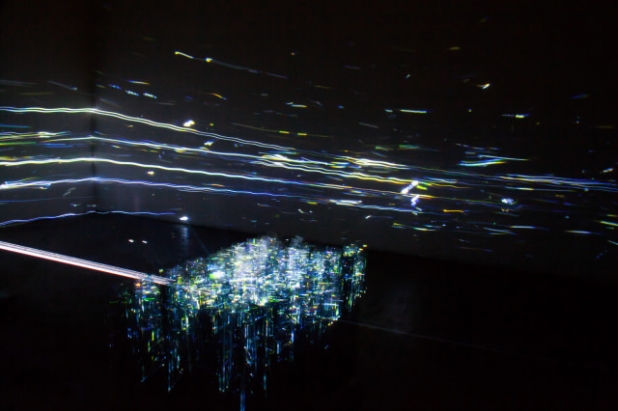

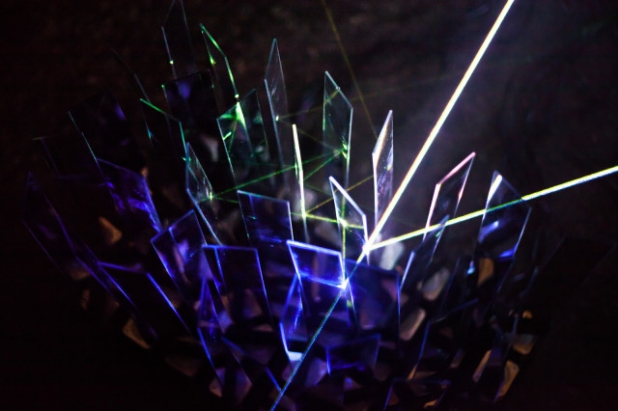

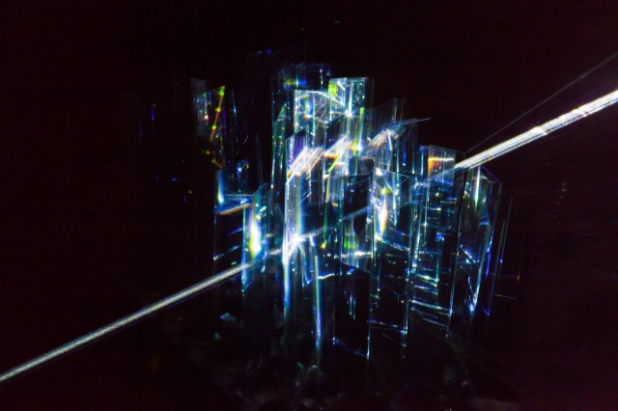

Diese Installation wurde von Shohei Fujimoto für die BankArt Gallery in Japan zwischen dem 06 bis10 Feb 2013 gemacht. Dieses Werk beschäftigt sich mit input und output durch Laserlicht und rotierenden Spiegeln. Ein weisser Laser, 40 Stepper Motoren und 40 Spiegel wurden so angeordnet dass sie einander unendlich reflektieren und die Lichtstrahlen zu einem Kaleidoskop von Licht wird.

©Shohei Fujimoto und Creative Applications Network

The transitions therein, the value entered for the element group based on certain rules is increased or decreased. Elements one by one is a medium for receiving the value given to the elements of the other value being held. Transition value is input, decrease is repeated continuously quietly inside the element group, value was generated therein transitions as newly output from the inside to the outside, it may be a new input. Value that was born in a state of input, is allowed to collapse the relationship of output, was the coexistence of both do not ambiguous presence. (translated from Japanese) Shohei Fujimoto

©Shohei Fujimoto und Creative Applications NetworkBeitrag von Ursula Drees

©Daniel Rozin_DEZEEN_Weave Mirror

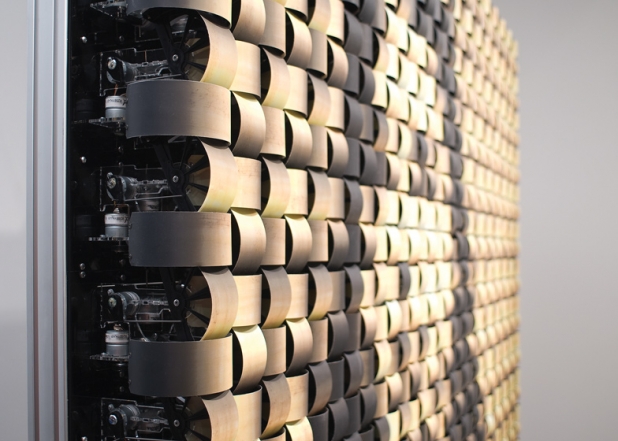

Mechanical Mirrors von Daniel Rozin: Mit Alltagsobjekten stellt er Spiegelbilder her. Daniel Rozin ist kein Newcomer. In seinen interaktiven Installationen werden Motoren und Senoren verwendet um Objekte zu spiegelartigen Flächen zu machen. Wer sich vor diese Installationen stellt, wird entsprechend abgebildet. Alle möglichen Gegenstände werden gesammelt, zusammengefügt und mechanisch betrieben. Kleine Plastikstreifen, alte DVD’s, Holzstöpsel, -Stifte oder Zapfen. Rozin fügt sie zu Bildern zusammen, mit und ohne Rahmen. Hinter jedem Objekt oder Bild befinden sich versteckte Kameras die real time die gesehenen Daten an einen Rechner vermitteln, der konvertiert das Signal-Bild in einen 830 byte Video Signal. Selbstgeschriebenen Software schickt an jeden Motor entsprechende Signale und die kleinen Module richten sich aus. Das Resultat ist ein Spiegelbild einer Person oder eines Objekts.

©Daniel Rozin_DEZEEN_Peg Mirror

„The mechanical mirrors are made of various materials but share the same behaviour and interaction,“ so Rozin. „Any person standing in front of one of these pieces is instantly reflected on its surface.“

Ich habe schon das ein oder andere Spiegelbildwerk gesehen und live erzeugt. Die kleinen Motoren arbeiten, summen und knacken, bis die richtige Position erreicht ist. Dann entsteht das Bild, entweder rudimentär, wie in alten Pixelzeiten oder abstrahiert. Spannend wie die Motoren entsprechende Reflexionswinkel einnehmen um Hell- Dunkel produzieren. Es ist belebt.

Seine aktuelle Arbeit, „Angles Mirror“ besteht aus 465 Plastikspeichen in einem Dreieck.

©Daniel Rozin_DEZEEN_Angles Mirror

Beitrag von Ursula Drees

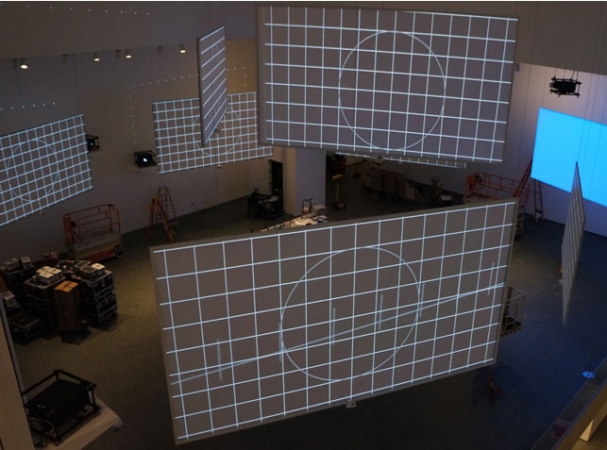

Installation view of Isaac Julien: Ten Thousand Waves at The Museum of Modern Art. Photo: Jonathan Muzikar

Isaac Julien: Ten Thousand Waves_ November 25, 2013–February 17, 2014

The Donald B. and Catherine C. Marron Atrium, 2. Etage I’m MOMANew York

Ten Thousand Waves (2010) wird als immersive Projektion vom MOMA New York beworben. Auf 9 doppelseitigen Projektionsleinwänden werden Besucherbewegungen im Raum abgebildet. Die Installation wurde sowohl im alten als auch modernen Shanghai installiert. Immersivität ist ein gern gesehener Begriff. Die unmittelbare Einbeziehung, das in einer anderen Sache aufgehen, Selbstvergessenheit und Eintauchen in das Andere ist damit gemeint. Ist diese Installation visuell immersiv?

Installation of Isaac Julien’s Ten Thousand Waves at MoMA, November, 2013. Photos: Ashley Young

Mit einprägsamen Bildern und grossen Sounds? Ist die Installation vielleicht sogar technisch immersiv? Mit Bildern in real time, vor Ort oder woanders eingefangen und dann gezeigt? Bilder sind nicht einfach. Gerade die Zufälligen brechen einer Installation möglicherweise das Genick.

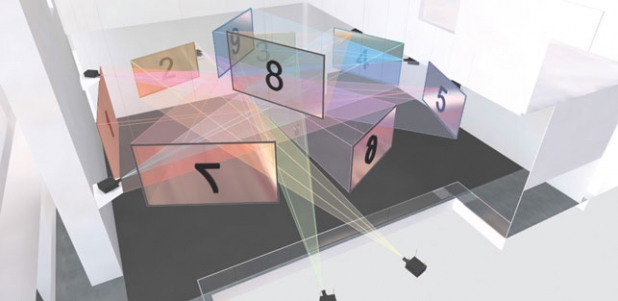

Previsualization of Isaac Julien’s Ten Thousand Waves installation at MoMA. Digital renderings by Aaron Harrow

Hier hat eine Auswahl und Postproduction stattgefunden. Die schiere Faszination an der Menge der Bilder und an der doppelseitigen Projektion wird demonstriert. Und das ist es was die Grossartigkeit unterstreicht. Als nächstes stellt sich die Frage nach einer Geschichte. Werden wir mit Assoziationen unserer eigener Gedankenwelt überlassen? Oder wird eine Geschichte deutlich gemacht? Stefan Grandinetti, Professor für Kinematographie an der Stuttgarter Hochschule der Medien hat sie mir ans Herz gelegt. Er hat sie gesehen. Ich war in Berlin. Vielleicht muss ich ihm meine Fragen stellen.

Isaac Julien. Ten Thousand Waves. 2010. Nine-channel video installation (color, sound). 49:41 min. The Michael H. Dunn Memorial Fund. The Museum of Modern Art, New York. Photo: Jonathan Muzikar.

Die Musik kommt von den Londoner Musikern Jah Wobble und dem Chinese Dub Orchestra. Sie basiert auf der Komposition des Spanischen klassischen Komponisten Maria de Alvear.

Beitrag von Ursula Drees

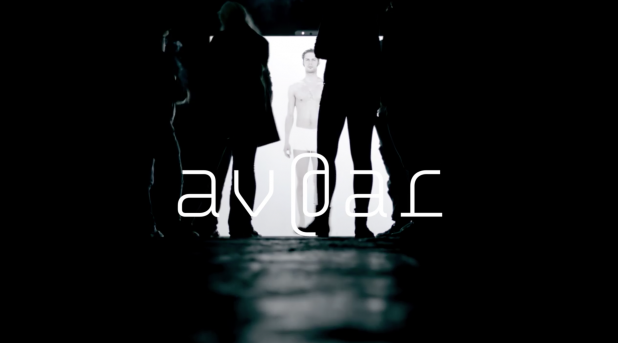

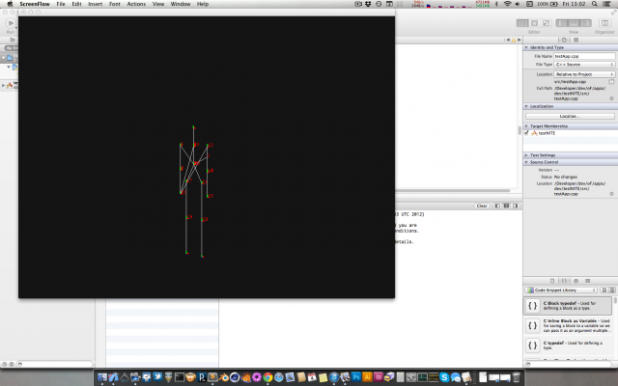

©av@ar von Manfred Borsch, interaktive Installation mit Gestenerkennung

Wir stellen die Diplomarbeit von Manfred Borsch, videograph, mit dem Titel „av@ar“ vor. Sie entstand am Institut Für Musik Und Medien. Herr Borsch hat nach der ersten Sicht freundlicherweise in einem online Interview Hintergrundfragen beantwortet. Mit diesem Wissen steigt der Genuss am Werk. es ist poetisch und hintergründig. Hintergründig weil die Interaktion sowohl aktiv als auch inhaltlich erarbeitet wird. Wer nicht genau hinschaut kann die Tiefe des Werks übersehen. Und das wäre schade.

UD: „Wie wird die Gestenerkennung gemacht? Haben sie Kinects eingesetzt? Wird Mimik abgenommen? Wenn ja, wie haben sie das technisch gelöst?“

MB: Die Gestenerkennung ist wie von Ihnen richtig vermutet mit einer Kinect, OpenNI mit NITE Middleware und der Programmierungsumgebung Max/MSP/Jiitter realisiert worden. Die Mimik wird nicht durch die Kamera aufgenommen, trägt jedoch thematisch zum geschlossenen Kreislauf der Installation bei.

Als Avatar wurde ein Mensch (und eben nicht eine digitale Form, wie beispielsweise eine Pixelansammlungen) gewählt, da durch Spiegelneuronen die Bindung zwischen BesucherIn und Abbild erhöht wird. Hierzu zählt auch das (teils unbewusste) Nachahmen von Emotionen mit der Gesichtsmuskulatur. Da alle Auswirkungen des Handelns in der Installation erforscht werden sollen, es also keine Spielanleitung o.ä. gibt, ist den InterakteurInnen zu Beginn nicht bekannt, ob sie auch mit ihrer Mimik einen Einfluss auf das Geschehen haben.

Diese Abhängigkeiten können im geschlossenen Kreislauf erkundet werden, was sich auf die Wechselseitigkeit von Körper (Interface) und Emotionen (audiovisuelle Reaktionen) gründet.

Bekannt ist die Richtung, dass Emotionen erlebt werden und sich daraufhin das Körperliche verändert, beispielsweise in der Gesichtsmuskulatur, die sich zu einem Lachen hin verzieht. Dies beschreibt beispielsweise Paul Ekman mit dem Facial Action Coding System. Andersherum zeigt die Kognitionswissenschaft im Forschungszweig Embodiment, dass Gefühle auch nach der körperlichen Regung erzeugt werden können. Ein bekanntest Beispiel hierzu ist der quer in den Mund genommene Bleistift, der zur Anspannung von Muskeln im Gesicht führt, die eigentlich zum Lächeln benutzt werden. Forschungen haben ergeben, dass ein solcher, emotional unbewusster, äußerer Einfluss zu deutlich positiveren Bewertungen von Situationen führt, als bei der neutralen Vergleichsgruppe.

©av@ar von Manfred Borsch, interaktive Installation mit Gestenerkennung

Generell steht in der Installation die Frage der Kontrolle, der Auswirkung, im Mittelpunkt. Was kann ich direkt kontrollieren? Wo erlebe ich Kontrollverlust? (zufällige Fehler zur Kontrollminderung sind vorhanden.) Und in wieweit werde ich kontrolliert/geleitet, also wonach richte ich mein Handeln aus. Diese durch die Überlagerung der Rezeptions- und Handlungsebene sehr individuelle Erfahrung kann zur Reflexion über eigene Handlungsziele führen. Beispielsweise kann ich erlernte Körperhaltungen wiederholen, um dem umherstehenden Publikum zu zeigen, dass ich Kontrolle ausübe, ich kann mich auf die Suche nach neuen Bildern und Tönen machen, ich kann die Synchronität der Bilder und der Musik in den Mittelpunkt stellen (VJing) oder mich zu der Musik bewegen, die ich durch meine Bewegung selber schaffe.

UD: Wie viele Reaktionen des medialen Ichs wurden vorproduziert?

MB: Es gibt 16 Einzelemotionen, die in vier Gruppen, den sogenannten Basisemotionen unterteilt sind. Mehr dazu unten… 🙂

Mit dem Überbegriff der Basisemotion versehen, werden die Emotionen wie folgt gruppiert:

Angst, Neid, Scham, Trauer: negative Emotion, passives Verhalten

Freude, Bewunderung, Stolz, Glück: positive Emotion, aktives Verhalten

Liebe, Mitleid, Dankbarkeit, Hoffnung: positive Emotion, passives Verhalten

Hass, Verachtung, Ärger, Verzweiflung: negative Emotion, aktives Verhalten.

©av@ar von Manfred Borsch, interaktive Installation mit Gestenerkennung

UD: Gibt es eine Relation zwischen den Einstellungsgrössen und den Besucheraktivitäten. Wann wird eine Detail oder Gross Einstellung genommen wann Halbtotale oder Totale?

MB: Es gibt eine mögliche Raum- und eine Körpererfahrung.

Der Raum kann in seiner Tiefe (Abstand der AkteurInnen zur Leinwand) erforscht werden, worauf sich die mediale Reflexion nach der Proxemik (E.T. Hall) in vier Stufen anpasst. Dies ist eingeteilt in die öffentliche Distanz (> 3m), gesellschaftlich-wirtschaftliche Distanz (1,5-3m), persönliche Distanz (0,5-1,5m) und die intime Distanz (< 0,5m) und wird so auch visuell Abgebildet (tief im Raum, als Spiegelsituation, Portraitdarstellung und Detailaufnahme. Je kleiner der Abstand, desto dezenter die dargestellte Emotion). Der Raum kann auch im Volumen erfahren werden, ausschlaggebend hierfür ist die durchschnittliche Höhe beider Hände. Hier können die vier Basisemotionen angesprochen werden. (Bsp.: Befinden sich beide Hände über der Kopfhöhe, wird die Basisemotion Angst angesprochen. Befindet sich der Akteur sehr nah vor der Leinwand, erscheint die Detailaufnahme – intime Distanz – des sich aufreißenden Auges). So ist der Raum mit vier Basisemtionen komplett abgedeckt.

Darüber hinaus können die weiteren 12 (Sekundär-)Emotionen durch bestimmte Körperhaltungen angetriggert werden. Hierbei muss erforscht werden, welche Körperhaltung zu welcher audiovisuellen Reaktion führt. (Bsp.: Beide Hände auf die Hüften gestützt, Oberkörper aufrecht -> Emotion Stolz). Auch diese Sekundäremotionen sind auf den vier verschiedenen Distanzebenen darstellbar, sodass es insgesamt (16×4) 64 vorproduzierte visuelle Reaktionen gibt.

©av@ar von Manfred Borsch, interaktive Installation mit Gestenerkennung

UD: Reagiert die Musik auch?

MB: Die Musik reagiert ebenso auf das Handeln der AkteurInnen, entzieht sich jedoch zum Teil durch Statistiken. Die Komposition unterteilt sich in vier Ebenen, die stets zusammen erklingen, und sich auf die vier deutschen Begriffe zur Emotion gründen. (Affekt, Gefühl, Emotion und Stimmung: je kürzer die Emotion, desto Objektbezogener. Ein Affekt (sehr kurz) ist somit sehr objektbezogen.) Die oberste musikalische Ebene (Affekt-Ebene) ist direkt an das Bild gekoppelt und kann zu jedem Zeitpunkt angespielt werden. Sie verton sehr genau alle 64 dargestellten Bilder. Die darunter liegende Gefühlsebene ist doppelt so lang (zwei Takte), berechnet sich aus dem Durchschnitt der zuvor angetriggerten Affekten und stellt die 16 Emotionen dar. Ebene drei (Emotionsebene) ist wiederum länger (vier Takte), wird aus dem Durchschnitt der angespielten Affekten berechnet und vertont die vier Emotionsgruppen (s.o.). Die längste Ebene (Stimmungsebene) unterscheidet nur noch zwischen positiv-annähernd und negativ-ablehnend (der emotionalen Grundtendenzen Neugeborener nach) und ergibt sich aus den Handlungen der letzten acht Takten (ca. 26 Sekunden).

Die musikalische Komposition (Tonart, Rhythmus, Melodie,..) bezieht sich hierbei auf die Affektenlehre des Barock, ein Regelwerk, dass sehr klare Vorgaben zur Vertonung von Emotionen vorsah, sich also sehr gut in den Grundcharakter der Installation einfügt, in der etwas sehr Menschliches wie Emotionen radikal in Gruppen einsortiert, systematisiert und damit abrufbar gemacht wird.

Ich bedanke mich für die inhaltsvollen und Erkenntnis unterstützenden Antworten!

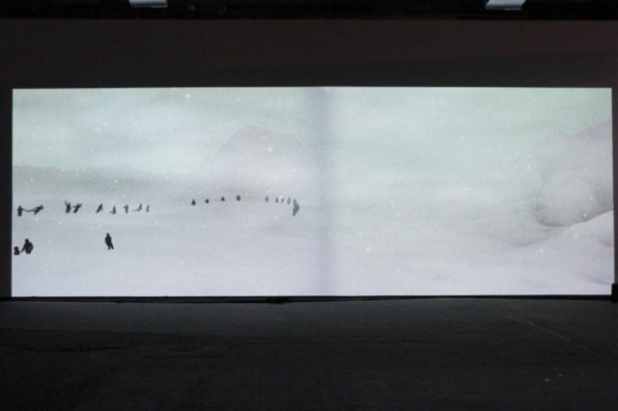

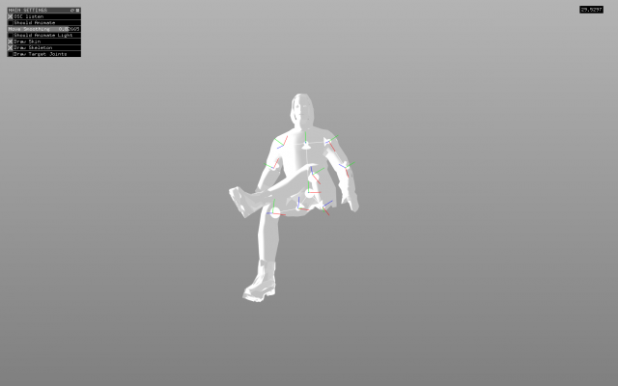

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

Gemacht wurde Ghost von Thomas Eberwein / Thomas Traum und Tim Gfrerer. In Ghost geht es um einen interaktiven Schneesturm, ein wüstes Naturereignis durch eine verlassene und karge Landschaft. Der Besucher findet sich in diesem Szenario wieder und muss sich retten. Wie kommt er heraus, ist er verloren und wird er den Kampf um Leben und Tod verlieren? Die Körper der vorherigen Besucher säumen seinen Weg und sein Bemühen. Ein unheimliches Umfeld.

Mehr unter http://thomastraum.com/#works/ghost/

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

Man sieht die Landschaft aus der Sicht eines überfliegendes Auges (Kamera), unterbrochen von einer Reihe vorproduzierter Stimmungen. Die Landschaft und die Stimmung beeinflussen die Intensität des Sturms, die Musik, die Farbe des Nebels und die Geräusche. Die Szenerie kann von intensiv, laut und aggressiv zu einem fast schon friedlichen, leisen Schneegestöber wechseln. Wird ein Besucher registriert, bewegt sich die Kamera auf ihn zu. Man sieht eine Reihe Naheinstellungen des Umfelds. Wenn niemand mit dem Werk interagiert, wechselt die Kamera auf Panoramaeinsteillungen, die auf ewig gefangene Geister der vorherigen Besucher zeigen.

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

Die Installation wurde mit openFrameworks gemacht. Landschaft und Charaktere in einer 3D Modelling Software. Die über das menschliche Skelett abgeleiteten Bewegungen sind entworfen und neu programmiert. Besucherbewegungen werden ebenso von ihren Skeletten abgeleitet und mit der Open Source Software OpenNI framework aufgezeichnet. Die Daten werden mit OpenNI (Open Source Software) in die Hauptapplikation eingespeist. Dort findet das Einfügen der Bewegungen statt, und gleichzeitig eine Umwandlungen in Geister für spätere Verwendung in den leeren Landschaften. Die atmosphärischen Komponenten wie Farbe, Windgeschwindigkeit, Wolken, Nebel und Schneeintensität sind mit der Musik abgestimmt.

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

Spezielle GLSL shaders übernehmen die Charakter Animation. Sie werden in real time abgespielt und entwickelt um bis zu 100 Geister gleichzeitig animieren zu können. Gut 400 MB Skelettanimationen entstanden dabei. Sie werden in späteren Projekten und Einsätzen von Ghost verwendet.

Ghost entstand als Thomas Eberwein als Interactions Designer beim EPFL+ECAL Lab in Lausanne, Switzerland tätig war. Es ist eine Auftragsarbeit für die Ausstellung mit dem Titel “Give Me More” vom EPFL+ECAL Lab in der Eyebeam gallery in NYC im Frühjahr 2013. Die Musik kommt von Freefarm.

© creative application und Thomas Eberwein / Thomas Traum und Tim Gfrerer

http://www.creativeapplications.net

Autor von Creative Applications: Filip Visnjic

Beitrag in Deutsch von Ursula Drees