Tag Archives: Sound

Photo by Yasuhiro Tani, Courtesy of Yamaguchi Center for Arts and Media [YCAM]

Bei diesem Werk arbeitet eine Artifizielle Intelligenz und ein Mensch unter gleichen Bedingungen zusammen. Beide legen Platten auf, sie sind DJs. Zumindest werden die Bedingungen so gut wie möglich aneinander angeglichen. Denn die artifizielle Intelligenz verwendet den gleichen Plattenspieler und hat sogar eine physische Hand, die diesen Plattenspielertyp bedient. Und so macht es auch der Mensch.

Photo by Yasuhiro Tani, Courtesy of Yamaguchi Center for Arts and Media [YCAM]

Das System hört den unterschiedlichen Tracks des Menschen DJ zu und ermittelt den Beat, Rhythmus und Art der Musik. Nachdem der Mensch aufgelegt hat, beginnt das artifizielle Intelligenzsystem den nächsten Track aufzulegen. Es fixiert das Tempo des nächsten Tracks und gleicht es dem des menschlichen DJ Tracks an. Es geht dem VR DJ darum, dass beide Tracks einen guten Übergang finden und die Rotationsgeschwindigkeit des Plattenspielers ähnlich ist. Hier kommt der Roboter – Finger zum Tragen, denn er manipuliert durch Berühren der Vinylplatte die Geschwindigkeit der Drehung. Es wird Musik ausgesucht, der Beat wird nahtlos dem neuen Track angepasst, es wird verglichen und abgeglichen. Als weiteres Feature, wird die Tanzmenge, die vor den DJs steht, analysiert.

Denn ein guter DJ liest sein Publikum, er schaut auf ihre Vorlieben, ermittelt was funktioniert und nicht. Er kommuniziert, schaut Tanzenden in die Augen, lacht, tanzt; er fordert sie zum mitgehen auf. Ein schlechter DJ macht das nicht, der schaut auf sein Mischpult und zieht das vorher geübte durch und ab. Er geht nicht auf die Menge ein. Und dann kann es für den Partygänger zu einer wenig stimmungsvollen Nacht kommen.

Photo von MvT

Dieses System, der AI DJ betrachtet die Menge. Eine Kamera nimmt die Daten auf, analysiert sie und gibt den Datensatz, nach einer Bewertung weiter. Auf dieser Basis sucht der AI DJ Tracks, die eine ähnliche Stimmung erzeugen. Das verfolgt die AI so lange, bis die Bewegung der Tanzenden schwächer wird. Dann werden verschiedene Musikstücke ausprobiert und getestet, ob das Publikum weiterhin gelangweilt ist oder wieder mitgroovt.

Der Mensch DJ erlebt sicherlich die ein oder andere Überraschung, wenn der AI DJ ungeahnte Tracks selektiert. Das kann Spaß machen, kann zu Verwirrung gleichermaßen führen. Ebenso hofft der Mensch DJ sicherlich auch, dass der AI DJ seine Ansprüche und Anforderungen erfüllt. So ein System birgt Ungeahntes in sich.

Photo von MvT

Es ist eine herausragende Arbeit, die eine Kommunikation mit den Menschen und einem artifiziellen Intelligenzsystem ermöglicht. Die Autorin fragt sich, ob dieses System nicht eine Berufsgruppe in Bälde in Pension schickt. Denn der AI DJ kann mehr oder minder all das was auch ein Mensch DJ macht. Vielleicht reicht es, einem AI DJ eine Auswahl an Stücken zu geben und dann geht es los?

Vielleicht aber reagiert ein Mensch besser auf Stimmungsschwankungen im Publikum?

Photo von MvT

Aber es kann natürlich ohne weiteres passieren, dass die artifizielle Intelligenz coolere Musik auflegt. Momentan greift das System noch auf 350 vorselektierte Tracks zurück. Aber das könnte sich auch ändern. Wir wissen das nicht. Dieses Projekt in jedem Fall, fasziniert durch Technik und Intelligenz, durch Mensch-Maschine Zusammenarbeit und Funkyness.

Prämiert auf der Ars Electronica mit einer Anerkennung. Hintergrundinformationen gibt es hier. Dieser Beitrag wurde im ÖK, anlässlich der Ars Electronica in Linz gesehen.

Beitrag von Margarete von Trifft.

Die Studioproduktion Event Media unter der Leitung von Prof. Ursula Drees von der Hochschule der Medien in Stuttgart hat mit einem 8 köpfigen studentischen Team für ihr Werk „Schatten“ bei den CommAwards GOLD gewonnen. GRATULATION!

Auf der Site des CommAwards wird die Leistung hervorgehoben. „Absoluter Jury-Liebling und Highlight des CommAwards war der beeindruckende Erfolg des Studiengangs Audiovisuelle Medien der Hochschule der Medien Stuttgart. In der Kategorie RAUM erhielt die Studentenarbeit die einzige Gold-Auszeichnung und verwies selbst Koryphäen wie KMS und Atelier Brückner auf die bronzenen und silberne Ränge. Auf 125qm inszenierten drei Studentengruppen der HDM Stuttgart im Rahmen der MediaNight eine räumliche Adaption des szenischen Kurzfilms „Schatten“ und begeisterten die Jury restlos.“

Auf der Site des CommAwards wird die Leistung hervorgehoben. „Absoluter Jury-Liebling und Highlight des CommAwards war der beeindruckende Erfolg des Studiengangs Audiovisuelle Medien der Hochschule der Medien Stuttgart. In der Kategorie RAUM erhielt die Studentenarbeit die einzige Gold-Auszeichnung und verwies selbst Koryphäen wie KMS und Atelier Brückner auf die bronzenen und silberne Ränge. Auf 125qm inszenierten drei Studentengruppen der HDM Stuttgart im Rahmen der MediaNight eine räumliche Adaption des szenischen Kurzfilms „Schatten“ und begeisterten die Jury restlos.“

„Die acht Studierenden sind keine Anfänger, einige von ihnen habenden die Studioproduktion als Fach zum zweiten oder gar dritten Mal belegt. Die Erfahrung und ihr Können machen sich bemerkbar, denn diese Studioproduktion ist ausgefeilt und durchdacht. Jedes Element passt zum nächsten, jede Technologie steht mit den Inhalten im Einklang. Ein durchweg stimmiges Werk, dass die Auszeichung GOLD verdient hat. “ Ursula Drees

Wir gratulieren!

Ausführliche Informationen zum Projekt finden sie hier.

HdM-Studenten inszenieren den Stuttgarter Hafen

Am 25. März 2017 ab 19 Uhr stellen Studenten der Hochschule der Medien (HdM) in Kooperation mit dem Hafen Stuttgart bei der „Langen Nacht der Museen“ ihr Projekt „Grenzgebiete“ vor. In sieben Installationen loten sie die Grenzen zwischen Land und Wasser aus. Die HdM-Studenten schaffen optische Illusionen und irrationale Wahrnehmungen. Licht- und Klangobjekte, interaktive Installationen und Projektionen an Gebäude- oder Wasserwänden erweitern den Raum des Vorstellbaren im Hafen.

Der Neckar verbindet Stuttgart und die Region mit dem Rest der Welt. Der Hafen inspiriert als Grenzgebiet mit seiner, urbanen, industriellen Atmosphäre immer wieder Künstler. So auch die HdM-Studenten aus dem Studiengang Audiovisuelle Medien und Medienwirtschaft. Sie beschäftigen sich in der „Studioproduktion Event Media“ unter der Leitung von Prof. Ursula Drees und Steffen Mühlhöfer mit der Inszenierung von interaktiven Erlebnisräumen. Das ist diesmal der Hafen, als Grenzgebiet für Wasser und Land, Stadt und Landkreis, Bewegung und Stillstand, Verortung und Übergang. Diese Themen inszenieren die Studenten in sieben Installationen, in denen sie Grenzen verschieben.

Grenzlichter, Grenzübergänge, Grenzverschiebungen und Grenzfälle

Im überdachten Boarding-Bereich wird den Besuchern, die auf die Abfahrt der Passagierschiffe warten, ab 20.30 Uhr zur vollen und zur halben Stunde eine interaktive Projektion am Containerterminal geboten: Tänzerinnen setzen mit ihren Bewegungen neue Grenzen. An einer weiteren Station, „Grenzlichter“, schaffen die Besucher eine tonale Hafenkulisse durch die Berührung von Lichtstäben in einem Kubus. Die Fahrt unter der Otto-Konz-Brücke hindurch wird zu einem Licht- und Tonerlebnis: „Grenzübergang“ inszeniert mit emotionalen Licht- und Tonstimmungen im Inneren des Bootes die Durchfahrt durch einen Lichtbogen, nämlich der Brücke. An der Station „Grenzgewässer“ werden auf eine Wasserwand optische Illusionen der Unendlichkeit projiziert. Die Station „Grenzverschiebung“ ist ein Fassadenvideo-Mapping und zeigt das Innenleben, die sinnliche Wahrnehmung des Bauwerks. Die Station „Tiefengrenze“ stellt die Unterwasserwelt vor, projiziert direkt auf das Wasser. Eine weitere Station, eine Fassadenprojektion namens „Grenzfall“, hebt die Grenzen der Schwerkraft auf.

Abfahrt alle 30 Minunten

Die Schiffe legen ab 19 Uhr etwa alle 30 Minuten zu der insgesamt 20-minütigen Hafenrundfahrt ab. Gäste sind herzlich zum Besuch im Hafen eingeladen. Im Boarding-Bereich werden Getränke und ein kleiner Imbiss angeboten. Tickets für die „Lange Nacht der Museen“ gibt es online (https://www.lange-nacht.de/veranstaltungen/tickets-online/), bei den Vorverkaufsstellen (https://www.lange-nacht.de/vorverkaufsstellen/) oder an der Abendkasse.

Die Lange Nacht der Museen ist in Stuttgart ein Begriff.

Unter vielen anderen Begebenheiten und Attraktionen wird der Stuttgarter Hafen am Neckar für das Publikum zugängig und bepielt. In diesem Jahr wird die Hochschule der Medien, der Studiengang Audio Visuelle Medien und insbesondere 11 Studierende der Studioproduktion Event Media die Bespielung übernehmen.

Es sind verschiedene Installationen geplant, eine davon ist die Installation namens Grenzkörper. Diese Installaiton wird im Wartebereich vor dem Einstieg auf ein Schiff zu sehen sein. Dort sammeln sich die Besucher. Sie wollen nicht nur durch speise und Trank unterhalten werden, sondern natürlich auch durch kunstvolle Installationen und Bespielungen.

Deshalb wird beim Sammelbereich eine 3 x 6 große Bühne aufgebaut. Bühne ist vielleicht ein zu großer Ausdruck, ein Sockel. Darauf werden nicht nur Tänzerinnen halbstündig die Installation demonstrieren, es werden natürlich auch Besucher eingeladen, den Schritt auf den Sockel zu wagen und durch Bewegungen eine Projektion auf der anderen Seite des Hafenbeckens auf die Container zu verändern. Die Projektion zeigt abstrahierte Wasserpolygone. In diesen befinden sich Lichtpartikel. Sie strömen durch dieses Wasser. Tritt ein Besucher auf den Sockel werden Bewegung und Silhouette erkannt (Kinect v2 Kameras) und beeinflussen die Wasserbewegungen auf der Projektionsseite. Außerdem werden innerhalb des Projektionsraums weitere durch geometrische Figuren gekennzeichnet Bereiche sichtbar. Diese Bereiche sind mit Tönen verbunden. Wer sich bewegt verändert die Wasserströmung und komponiert gleichzeitig. Er sollte sich also wirklich bewegen.

![]()

Angefangen hat es mit visuellen Tests. Wie sieht das Wasser aus? Welchen Abstraktionsgrad wird es aufweisen? Wird die Strecke von 80 Metern von den Projektoren gut abgebildet. Weiviele Kontraste werden eingeplante. Wie ist die Farbsättigung? Wie werden die Projektionsbilder auf den farbigen Containern zu sehen sein? Einige Fragen sind bereits beantwortet, andere werden vor Ort bei den jeweiligen Tests angepasst.

Dann ging es um das Strömungsverhalten. Werden die Besucher überhaupt erkennen, dass sie etwas verändern und bewegen? Wie schnell muss sich was bewegen?

Und die Frage natürlich nach der Erkennbarkeit der Musikcluster im Raum.

Auf der Media Night an der Hochschule der Medien wurde Ende Januar ein Prototyp dem Publikum vorgestellt. Es war ein Testfall. Denn bis dato waren keine Usabilitytests mit Publikum gemacht worden. Die Fragen ob und wie sich Fremde in diesem Bereich verhalten waren offen. Mit einer Erklärgrafik oder wohl eher Poster wurde begonnen in der Hoffnung, dass die Leute dieses Plakat sehen, lesen und verstehen.

Die ersten Besucher kamen, sie wurden geleitet und verbal eingeführt und dann zeigte sich dass die Menschen sehr verhalten Bewegungen im öffentlichen Raum nachgehen. Sie standen vor der Projektion und schauten. Es wurde gezeigt was sich tut. Dann konnte es sein, dass der ein oder andere vielleicht die Hand anhob. Diese Zurückhaltung war unerwartet. Denn so konnten sie die Töne im Raum nicht finden und nicht erklingen lassen. Ein großer Teil der Installation schien verloren.

Deshalb wurde das tonale Feedback, nämlich das Erklingen des Tons, durch ein grafisches erweitert. Ein geometrisches Feld zeigte bei der Bewegung, an, dass sich an diesem Ort Etwas versteckt. Mit der visuellen Kennzeichnung fiel es den Besuchern ein wenig leichter Ihre Möglichkeiten mit dem System abzuschätzen und vielleicht in den Spielmodus zu kommen. Das visuelle Feedback stellt den Bezgu zwischen dem handeln und dem Hören dar. Erst dann erschien es deutlich.

Außerdem wurde die Soundspur den Besuchermöglichkeiten angepasst. In der vorlaufenden Testläufen spielt ein Background-Loop einen bestimmen Soundteppich ab. Das wurde gemacht um eine Stimmung zu erzeugen. Mit der Bewegung wurden Soundspuren diesem Loop zugefügt. Die Musik sollte sich verdichten und kompakter werden. Diese hinzugefügten Sounds wurden deshalb auch langsam eingefadet. DAs wiederum führte zu Erkennungsunklarheiten. Gehört dieser Soundcluster zum Defaultteppich oder habe ich das ausgelöst?

Deshalb wurden neue sehr kurze Töne auslösbar. Sie kommen sofort und ohne fade in. Sie sind an die Grafik gebunden, das visuelle Feedback. Dadurch wurde die Verständlichkeit für die Besucher erhöht.

Dennoch stehen Künstler vor der Problematik des musealen Verhaltens. Denn Besucher haben gelernt nichts zu berühren und zu verändern. Moderne interaktive Installationskunst ist jedoch genau darauf aufgebaut. Wer nichts tut erschließt das Werk nicht. Dann bleibt es verborgen. Das Ende ist noch nicht erreicht.

alle Photographien © Hochschule der Medien Studioproduktion EventMedia 2017

……..

Im Ars Electronica Center gibt es den Deep Space Präsentations Raum. Auf 16 x 9 m wird der Boden und die Stirnwand nahtlos mit 8 Galaxy NH 12 Projektoren von Barco bespielt. Es ist ein visuelles Erlebnis, der Raum verändert sich, wird zu einer Leinwand ohne Ecken und Kanten. Ein Meer an Möglichkeiten.

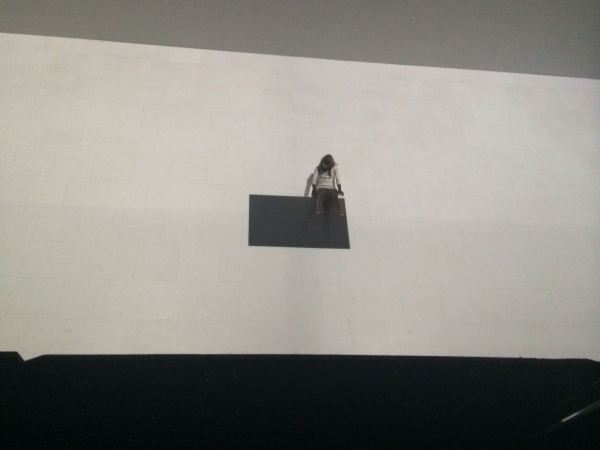

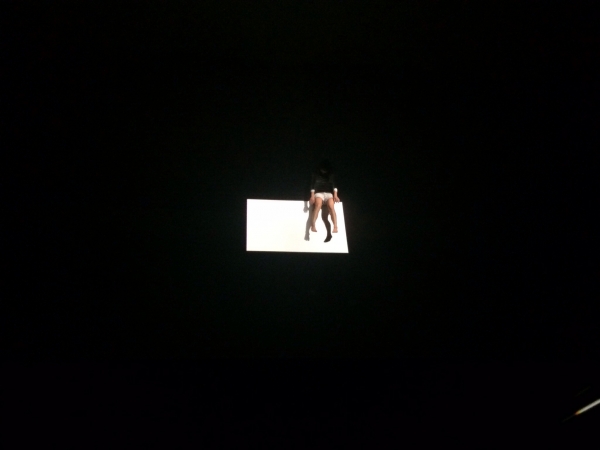

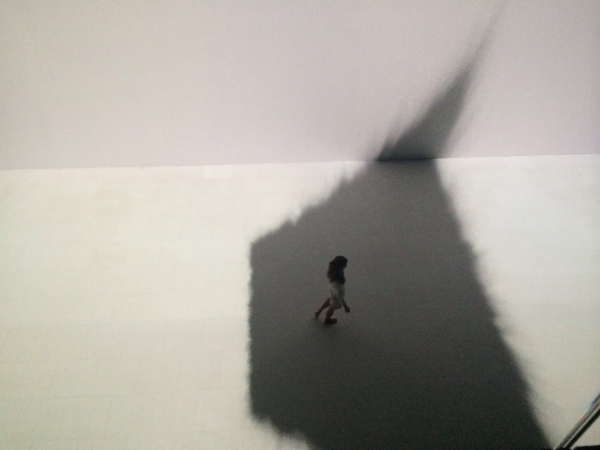

In diesem Raum wurde die Tanzperformance Anatta gezeigt. Die Geschichte handelt von dem Menschen, der aus seiner Lebenswelt heraustritt, hinein in die unbegrenzten Formen und Bewegungen, manche folgen, manche grenzen ab und endet wieder in seiner Welt.

Anfangs wird eine strenge schwarz weiss, grafische Umgebung geschaffen. Die Tänzerin mit federleichten Bewegungen und lautlosen Schritten und Sprüngen tritt aus. Grautöne, Schattierungen und grosse Formvielfalt erfüllt den Raum. Schön anzusehen.

Wenn nur die Beamer etwas lautloser wären und besser auf den Raum ausgerichtet, ohne Überlagerungen, dann wäre Deep Space als Aufführungsort nicht zu schlagen.