Category Archives: Klanginstallation

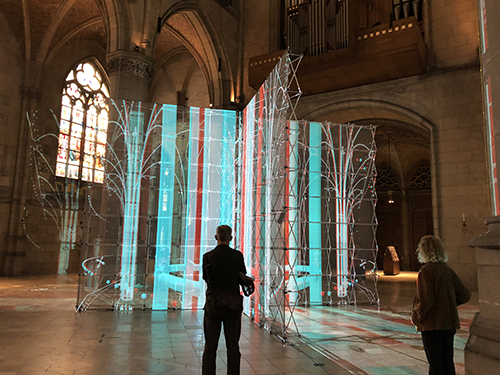

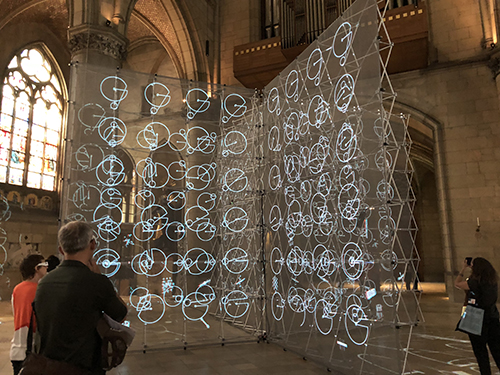

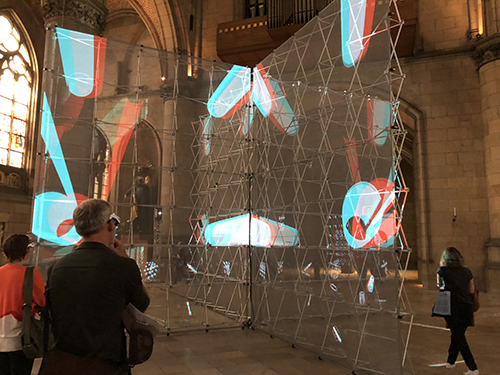

Light Tank von Uwe Rieger und Yonan Liu. Der Mariendom in Linz eignet sich hervorragend für großräumige Installationen. Es ist ein imposantes Gebäude. Von außen, als auch von Innen, wie jeder Dom. Die Höhe, die Breite, das Gestein und die Akustik sind beeindruckend, auch ohne Installation. Light Tank ist wie alle, von Uwe Rieger geschaffenen Installationen, auf den Raum ausgerichtet. Sie ist luftig, verfügt über eine faszinierende akustische Stimmung und ist von allen Seiten zu betrachten.

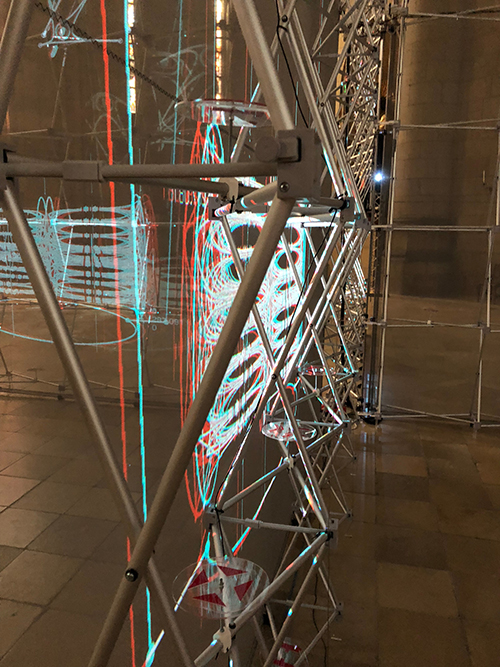

Light Tank ist eine Mixed Reality Installation. Es werden holographische Linien auf eine transparente Gerüststruktur projiziert. Diese Gerüste sind mit durchsichtigem Meshgewebe bezogen. Und wenn die Lichtlinien auf dieses Meshgewebe fallen, begreifen die Besucher, das es eine Projektionsfläche ist. Ohne Lichtprojektion erkennt man den skeletthaften Aufbau und schaut hindurch. Das Gerüst ist vielleicht zwischen 4,20 und 4,60 Meter hoch, in der Breite jeweils 3 Meter. Denn hier handelt es sich um, ein in Kreuzform aufgestelltes, Gerüst.

Die Projektionen aus Linien, die mit 3 D Brille auf der Nase, als Säulen entschlüsselt werden, zitieren die Dominnenarchitektur. Sie bewegen sich ununterbrochen, entstehen, zerfallen, bleiben einen Moment und schon geht eine weitere Bewegung los. Sie werden zu einer stilisierten Gewölbestruktur mit klar erkennbarem Schlussstein als Rosette. Türkis, Rot und Weiß, mehr Farben braucht es nicht. Wenn diese Art der Entstehung vollendet ist, werden Ikonographen auf dem Meshgewebe verteilt: Buttons betitelt mit Activate, drüber Kleine in Wireframe abgebildete Quader, die wie Container aussehen, darin Elemente. Manche sehen aus wie eine Gruppe von x, andere ein einzelnes in x Form dargestelltes Ding, dann wieder nur eine Schiene des x oder aber eine Säulenform. Es sind die Bestandteile des Großen. Die Kästen um diese Miniaturzeichen verschwinden und fliegen frei über das Gewebe, als suchten sie einen geeigneten Ort. Daraus werden eine Anzahl von kreisförmigen Zeichen. Sie sind abstrakt, aber jedes einzelne ist ein Teil eines Großen, es ist eine Gattung, ein Kreis mit Winkel und kleinem Kreis, einer mit Parallele und einem Kreis, einer mit Durchmesseranzeige, andere im Aussehen wie Packmanfresser. Daraus werden große Flächen, bewegte Ausschnitte von etwas anderem. Ein steter Fluss von Klein zu Groß, vom Detail zum Überblick.

Die Projektionen werden durch Geräusche begleitet. Vogelstimmen und entferntes Rauschen. Es kann Wind sein, es kann Meeresrauschen sein. Hört der Besucher auf eine Küste auflaufende Wellen? Ist der Wind vielleicht auch das Geräusch von Wandten? Es ist ein sphärische Musikkulisse. Sie lässt die Vorstellung wandern, vermengt sich mit den Projektionen.

Kleine Bauteile im Schwarm mit Meer und Wind begleitet werden zu Streben, die im Zentrum zum Architektur der Kathedrale werden. Es löst sich auf und beginnt von Neuem. Ein steter Fluss aus Entstehen und Zerfallen.

Es ist kontemplativ, über lange Zeiträume betrachten die Besucher die Projektion.

Uwe Rieger (DE/NZ) mit Yinan Liu (NZ). Stereoprojektionstechnik auf transparente Leinwände. Unterstützt durch das arc/sec Lab for Digital Spatial Orperation an der School of Architecture and Planning der Uiversity of Auckland. Das Interface wurde in Zusammenarbeit mit dem Augmented Human Lab am Bio Engineering Institute entwickelt, das durch Assoc. Prof. Suranga Nanayakkara geleitet wird. As AHLab konzentriert sich auf Human-Computer Interfaces als natürliche Erweiterungen unseres Körpers, Geistes und Verhaltens.

Gesehen auf der Ars Electronia 2018 im Mariendom

Beitrag von Prof. Ursula Drees

Photo by Yasuhiro Tani, Courtesy of Yamaguchi Center for Arts and Media [YCAM]

Bei diesem Werk arbeitet eine Artifizielle Intelligenz und ein Mensch unter gleichen Bedingungen zusammen. Beide legen Platten auf, sie sind DJs. Zumindest werden die Bedingungen so gut wie möglich aneinander angeglichen. Denn die artifizielle Intelligenz verwendet den gleichen Plattenspieler und hat sogar eine physische Hand, die diesen Plattenspielertyp bedient. Und so macht es auch der Mensch.

Photo by Yasuhiro Tani, Courtesy of Yamaguchi Center for Arts and Media [YCAM]

Das System hört den unterschiedlichen Tracks des Menschen DJ zu und ermittelt den Beat, Rhythmus und Art der Musik. Nachdem der Mensch aufgelegt hat, beginnt das artifizielle Intelligenzsystem den nächsten Track aufzulegen. Es fixiert das Tempo des nächsten Tracks und gleicht es dem des menschlichen DJ Tracks an. Es geht dem VR DJ darum, dass beide Tracks einen guten Übergang finden und die Rotationsgeschwindigkeit des Plattenspielers ähnlich ist. Hier kommt der Roboter – Finger zum Tragen, denn er manipuliert durch Berühren der Vinylplatte die Geschwindigkeit der Drehung. Es wird Musik ausgesucht, der Beat wird nahtlos dem neuen Track angepasst, es wird verglichen und abgeglichen. Als weiteres Feature, wird die Tanzmenge, die vor den DJs steht, analysiert.

Denn ein guter DJ liest sein Publikum, er schaut auf ihre Vorlieben, ermittelt was funktioniert und nicht. Er kommuniziert, schaut Tanzenden in die Augen, lacht, tanzt; er fordert sie zum mitgehen auf. Ein schlechter DJ macht das nicht, der schaut auf sein Mischpult und zieht das vorher geübte durch und ab. Er geht nicht auf die Menge ein. Und dann kann es für den Partygänger zu einer wenig stimmungsvollen Nacht kommen.

Photo von MvT

Dieses System, der AI DJ betrachtet die Menge. Eine Kamera nimmt die Daten auf, analysiert sie und gibt den Datensatz, nach einer Bewertung weiter. Auf dieser Basis sucht der AI DJ Tracks, die eine ähnliche Stimmung erzeugen. Das verfolgt die AI so lange, bis die Bewegung der Tanzenden schwächer wird. Dann werden verschiedene Musikstücke ausprobiert und getestet, ob das Publikum weiterhin gelangweilt ist oder wieder mitgroovt.

Der Mensch DJ erlebt sicherlich die ein oder andere Überraschung, wenn der AI DJ ungeahnte Tracks selektiert. Das kann Spaß machen, kann zu Verwirrung gleichermaßen führen. Ebenso hofft der Mensch DJ sicherlich auch, dass der AI DJ seine Ansprüche und Anforderungen erfüllt. So ein System birgt Ungeahntes in sich.

Photo von MvT

Es ist eine herausragende Arbeit, die eine Kommunikation mit den Menschen und einem artifiziellen Intelligenzsystem ermöglicht. Die Autorin fragt sich, ob dieses System nicht eine Berufsgruppe in Bälde in Pension schickt. Denn der AI DJ kann mehr oder minder all das was auch ein Mensch DJ macht. Vielleicht reicht es, einem AI DJ eine Auswahl an Stücken zu geben und dann geht es los?

Vielleicht aber reagiert ein Mensch besser auf Stimmungsschwankungen im Publikum?

Photo von MvT

Aber es kann natürlich ohne weiteres passieren, dass die artifizielle Intelligenz coolere Musik auflegt. Momentan greift das System noch auf 350 vorselektierte Tracks zurück. Aber das könnte sich auch ändern. Wir wissen das nicht. Dieses Projekt in jedem Fall, fasziniert durch Technik und Intelligenz, durch Mensch-Maschine Zusammenarbeit und Funkyness.

Prämiert auf der Ars Electronica mit einer Anerkennung. Hintergrundinformationen gibt es hier. Dieser Beitrag wurde im ÖK, anlässlich der Ars Electronica in Linz gesehen.

Beitrag von Margarete von Trifft.

Drei sechs Meter lange Nylonbeine, miteinander verbunden durch runde Endstücke, sehr robuste in denen Lautsprecher eingebaut sind, bewegen sich nach Tönen, Geräuschen. Die Bewegung ist schwerfällig, archaisch. Es sieht aus wie im postindustriellen Zeitalter. Langsam strecken sich die Beine, erheben sich mit letzter Kraft, wie es scheint, dann fallen sie schmetternd zusammen. Wo genau weiß niemand, das Areal ist abgesperrt. Die Bewegung ist nicht kontrolliert. Es ist kein Tanz oder Ablauf. Es ist ein schwerfälliges mechanisches Aufbäumen und Zusammenfallen. Hypnotisch fast. Die Künstler führen Experimente zu plastischen und klanglichen Prinzipien der Selbstorganisation durch. Die Nylonbeine werden durch klangliche und mechanische Einwirkungen und Geräten bewegt. Die Sounds sind atonal, mal leise mal laut, sie entsprechen den Verrenkungen der Skulptur. Es sieht aus wie eine Kreatur im Überlebenskampf, dramatisch und roh.

Bildergalerie:

Die Studioproduktion Event Media unter der Leitung von Prof. Ursula Drees von der Hochschule der Medien in Stuttgart hat mit einem 8 köpfigen studentischen Team für ihr Werk „Schatten“ bei den CommAwards GOLD gewonnen. GRATULATION!

Auf der Site des CommAwards wird die Leistung hervorgehoben. „Absoluter Jury-Liebling und Highlight des CommAwards war der beeindruckende Erfolg des Studiengangs Audiovisuelle Medien der Hochschule der Medien Stuttgart. In der Kategorie RAUM erhielt die Studentenarbeit die einzige Gold-Auszeichnung und verwies selbst Koryphäen wie KMS und Atelier Brückner auf die bronzenen und silberne Ränge. Auf 125qm inszenierten drei Studentengruppen der HDM Stuttgart im Rahmen der MediaNight eine räumliche Adaption des szenischen Kurzfilms „Schatten“ und begeisterten die Jury restlos.“

Auf der Site des CommAwards wird die Leistung hervorgehoben. „Absoluter Jury-Liebling und Highlight des CommAwards war der beeindruckende Erfolg des Studiengangs Audiovisuelle Medien der Hochschule der Medien Stuttgart. In der Kategorie RAUM erhielt die Studentenarbeit die einzige Gold-Auszeichnung und verwies selbst Koryphäen wie KMS und Atelier Brückner auf die bronzenen und silberne Ränge. Auf 125qm inszenierten drei Studentengruppen der HDM Stuttgart im Rahmen der MediaNight eine räumliche Adaption des szenischen Kurzfilms „Schatten“ und begeisterten die Jury restlos.“

„Die acht Studierenden sind keine Anfänger, einige von ihnen habenden die Studioproduktion als Fach zum zweiten oder gar dritten Mal belegt. Die Erfahrung und ihr Können machen sich bemerkbar, denn diese Studioproduktion ist ausgefeilt und durchdacht. Jedes Element passt zum nächsten, jede Technologie steht mit den Inhalten im Einklang. Ein durchweg stimmiges Werk, dass die Auszeichung GOLD verdient hat. “ Ursula Drees

Wir gratulieren!

Ausführliche Informationen zum Projekt finden sie hier.

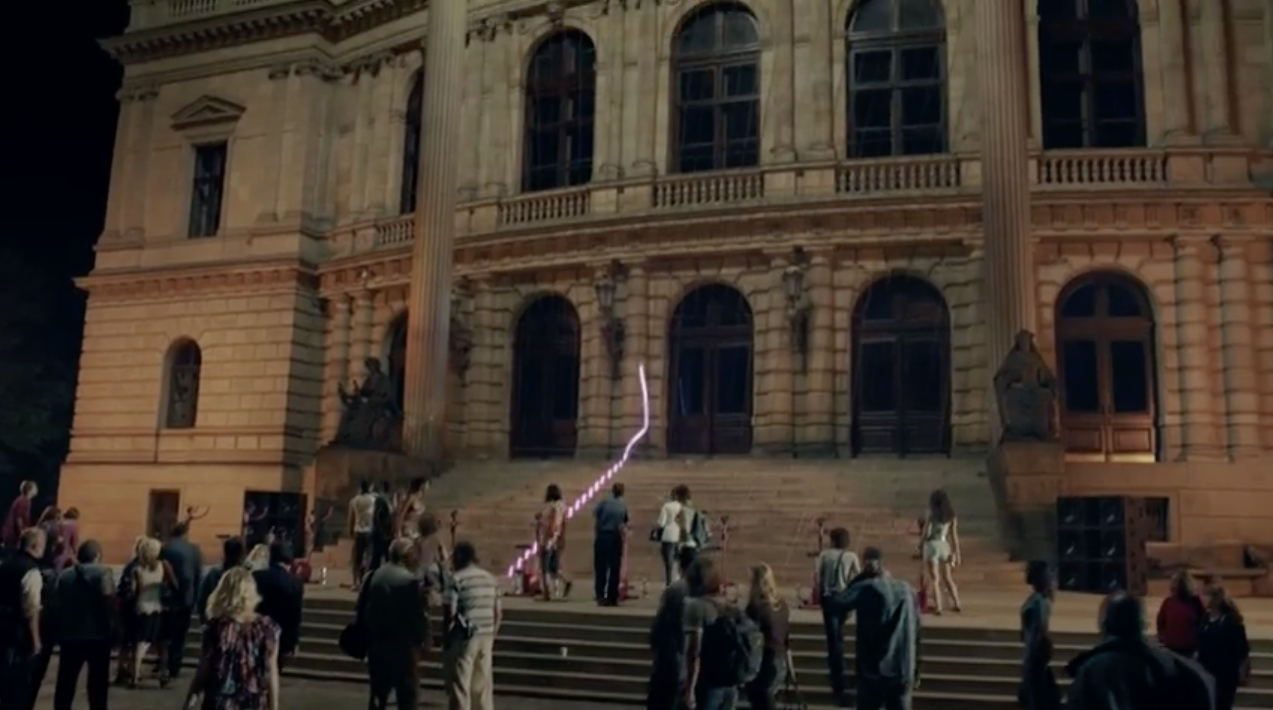

Vor mehr als 6 Jahren wurde im öffentlichen Raum Werbung zu einem interaktiven Erlebnis. Das Video spricht für sich. Es ist ein emotionales Erlebnis. So etwas schreibt sich schnell, aber es ist unendlich schwer so etwas zu erreichen. Die Leistung besteht in der Wahl der Mittel um Interaktion ohne jegliche Einführung im öffentlichen Raum zu erwirken. Es findet unter den Augen aller statt. Dafür gilt e,s den Handelnden scharf im Auge zu haben. Welche Elemente schaffen Aufmerksamkeit für eine Gruppe von Menschen, die nichts ahnend zu einer Aktivität verleitet werden sollen? Nicht wenige Menschen schauen sich die Aufbauten an, machen aber nicht den Schritt, sich aktiv zu beteiligen. Was also verleitet die Menschen dazu ihren Schatten zu überspringen, ihre Komfortzone zu verlassen und mitzumachen?

Die Farbe der Trimmräder. Die Anzahl der Trimmräder, Das Modell der Räder, die Aufstellung und Platzierung. Pink spricht mit weiblichen Teilnehmern. Es verspricht wenig Gefahr, Liebreiz und Harmlosigkeit. Da spricht Prinzessin Lillifee oder das rosa Einhorn.

Die Menge der Räder. Es sind viele, so viele, dass sie nicht mehr nur eine Gruppe oder eine kleine Auswahl darstellen. Das Modell ist alt bekannt, kein high Techrad, sondern eins aus den Fitnessstudios, die gerade über all zu bedienen sind. Das kennen wir das Modell, wer da nicht aufsteigen kann, wird sehr selten ein Fahrrad bestiegen haben.

Sie stehen ordentlich aufgereiht vor einem Präsidialbau. Gut sichtbar, die Blickrichtung zum Gebäude. Nicht in die Natur. Dazu entsprechende Ankündigungen und musikalische Effekte, als Default sogar immer mal wieder los laufende LED’s.

Und dann steigt eine Dame, zwei, drei, vier auf, treten in die Pedale und es geht los. Sofort. Das ist die gewünschte Interaktion und leicht. Das Feedback ist umgehend, keine Verzögerung. Ein LED Stripper erscheint. Musik unterstützt. Das Ziel ist entschlüsselt. Mehr Strom, mehr Pedale, treten und wer weiss, wo das endet. Wird der sich etwas vollständig ausziehen? Was kommt hier?

Einfache Interaktion, klare Handlungsanweisung, spannende Dramaturgie. Erfolg vorprogrammiert. Eine Leistung von den Konzeptern, den Ideengebern, den Programmierern, den Gestaltern, allen!

Made in Mikros Image http://www.mikrosimage.eu

Directed by Xavier Mairesse

Agency : Marcel

Production : Wanda

Flame Artist / VFX supervisor : Stephane Pivron

Grading : Jacky Lefresne

Motion Graphics : Caroline Mistral, Vincent Venchiarutti, Michael Moercant, Yannick Puggiani, Benjamin Pelletreau, Jean yves Parent

CG Supervisor & Supervisor on set : Stephane Thibert

Additional supervisor on set : Patrick Bennar

Compositing : Luc Martias

CG Trainee: Gaetan Baldy

Restore : Dany Lacarelle & Cyril Gohier